Als je de lanceringsvideo's op Adobe MAX 2020 hebt bekeken, heb je waarschijnlijk een paar trends opgemerkt tijdens de productdemo's.

Mobiel en sociaal waren (en zullen altijd) aandachtspunten zijn, maar kunstmatige intelligentie (AI) en machine learning (ML) - of Sensei zoals Adobe ervoor heeft gekozen om ze te brandmerken - betrad het podium op een aantal verrassende manieren.

Zoals altijd werd een groot deel van de zendtijd besteed aan Photoshop, dat een bundel van Sensei-gestuurde tools heeft toegevoegd, genaamd Neural Filters waaronder beeldopschaling, luchtvervanging en portretveroudering. Maar hoewel het leuk is om de klok vooruit te zetten op je gezicht, en het verwisselen van die uitgeblazen skyline met een standaard zonsondergang een landschap mooier maakt, is het moeilijk om veel commerciële waarde in deze tools te zien. Daarvoor moet je kijken naar de minst spraakmakende AI-functie in Premiere Pro:spraak-naar-tekst.

Laten we eens kijken waarom u het zou willen, hoe u het zou kunnen gebruiken en of deze machine learning-tool uw productiviteit kan verhogen.

Daar praten we niet over

Laten we even stilstaan bij het feit dat dit niet de eerste poging van Adobe is om een tool uit te brengen om opgenomen audio om te zetten in bewerkbare tekst. Spraakanalyse werd in 2013 toegevoegd aan Premiere Pro. Het was... niet geweldig.

Toen ik het destijds testte, zou de beste beschrijving voor de resultaten die het opleverde woordsalade zijn.

Maar om eerlijk te zijn, hetzelfde gold in die tijd ook voor andere software. De automatische transcriptie van Google voor YouTube-video's was net zo onbetrouwbaar. Zoals een commentator het uitdrukte "naar mijn ervaring doet het zo'n slecht werk dat de tijd die het me kost om het te corrigeren aanzienlijk meer is dan de tijd die het me kost om het zelf te transcriberen."

En dat was in een notendop het probleem. Het was dus niet echt verrassend dat Adobe Speech Analysis in 2014 uit de openbare release haalde en erover bleef zwijgen totdat de fantastische Jason Levine het in 2020 weer in de schijnwerpers zette.

Verschillende slagen

De motivatie voor het automatisch genereren van bijschriften hangt waarschijnlijk af van uw zakelijk perspectief.

Bedrijven als Google en Facebook willen het bijvoorbeeld omdat het video indexeerbaar en doorzoekbaar maakt, waardoor we inhoud in video's kunnen vinden (en voor hen advertentieruimtes kunnen verkopen op basis van de context).

Maar voor videoproducenten en -distributeurs komt de behoefte aan ondertiteling waarschijnlijk van een andere plaats.

Toegankelijkheid

De wetten rond toegankelijkheid zijn over de hele wereld verschillend, maar het dichtst bij een wereldwijde standaard zijn de Web Content Accessibility Guidelines (WCAG), gepubliceerd door het World Wide Web Consortium (W3C). Het is vermeldenswaard dat sectie 7.3 van de huidige WCAG aangeeft dat media zonder ondertiteling als een kritieke fout wordt beschouwd die automatisch het beoordelingsproces niet doorstaat.

In de VS heeft de FCC het al wettelijk verplicht gesteld dat alle tv-inhoud die in Amerika wordt uitgezonden, ondertiteld moet zijn, en elke daaropvolgende streaming van deze inhoud valt onder dezelfde regels.

En hoewel het waar is dat inhoud die uniek via internet wordt uitgezonden buiten deze regelgeving valt, is wetgeving, waaronder de Americans with Disabilities Act (ADA) al met succes gebruikt als basis voor rechtszaken tegen streamingplatforms zoals Netflix en Hulu.

Dus tegenwoordig is het waarschijnlijk veiliger om aan te nemen dat ondertiteling wettelijk verplicht is in het land/de staat waar je actief bent, dan om er op de harde manier achter te komen.

Sociale media

Hoewel het voldoen aan toegankelijkheidsvereisten een uitstekende rechtvaardiging is voor ondertiteling, is het ook gunstig voor doelgroepen die geen gehoorverlies hebben, vooral als het gaat om video op sociale media.

Gedempte autoplay wordt snel de norm voor video in scrollende sociale feeds, en naar schatting vindt maar liefst 85 procent van de videoweergaven plaats met het geluid uitgeschakeld. Dus als u de signaal-ruisverhouding van uw sociale media-inhoud wilt verbeteren, zijn ondertitels nu een essentieel onderdeel van het proces.

Wereldwijd bereik

En voor degenen onder ons die met wereldwijde markten werken, is het al lang bekend dat ondertiteling de gemakkelijkste manier is om uw film- en video-inhoud opnieuw te gebruiken voor doelgroepen die een andere taal spreken. (Zeker een stuk minder betrokken dan nasynchronisatie en ADR.)

Hoewel sommige vertaaldiensten rechtstreeks vanaf de originele media kunnen werken, kan het aanbieden van een ondertitelingsbestand in de originele taal het proces versnellen.

Er zijn natuurlijk nog andere redenen waarom ondertiteling snel een essentieel onderdeel wordt van de mediaproductie, en dat is niet alleen vanwege de memes.

Maar hoewel de behoeften van bedrijf tot bedrijf kunnen veranderen, is het fundamentele voordeel hetzelfde:het ondertitelen van uw media zal u helpen een groter publiek te bereiken. En dat is goed voor iedereen .

Laten we de show beginnen

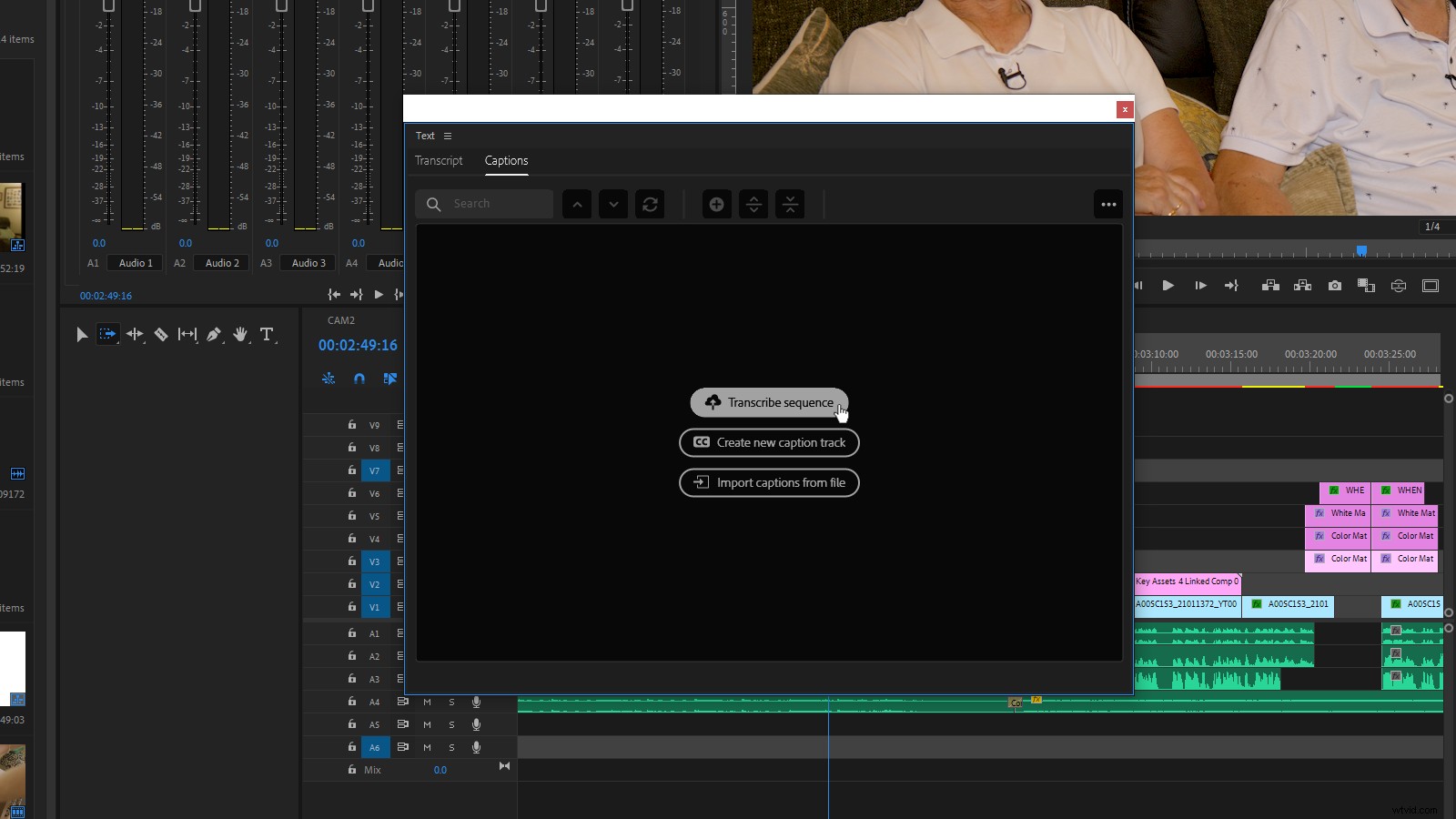

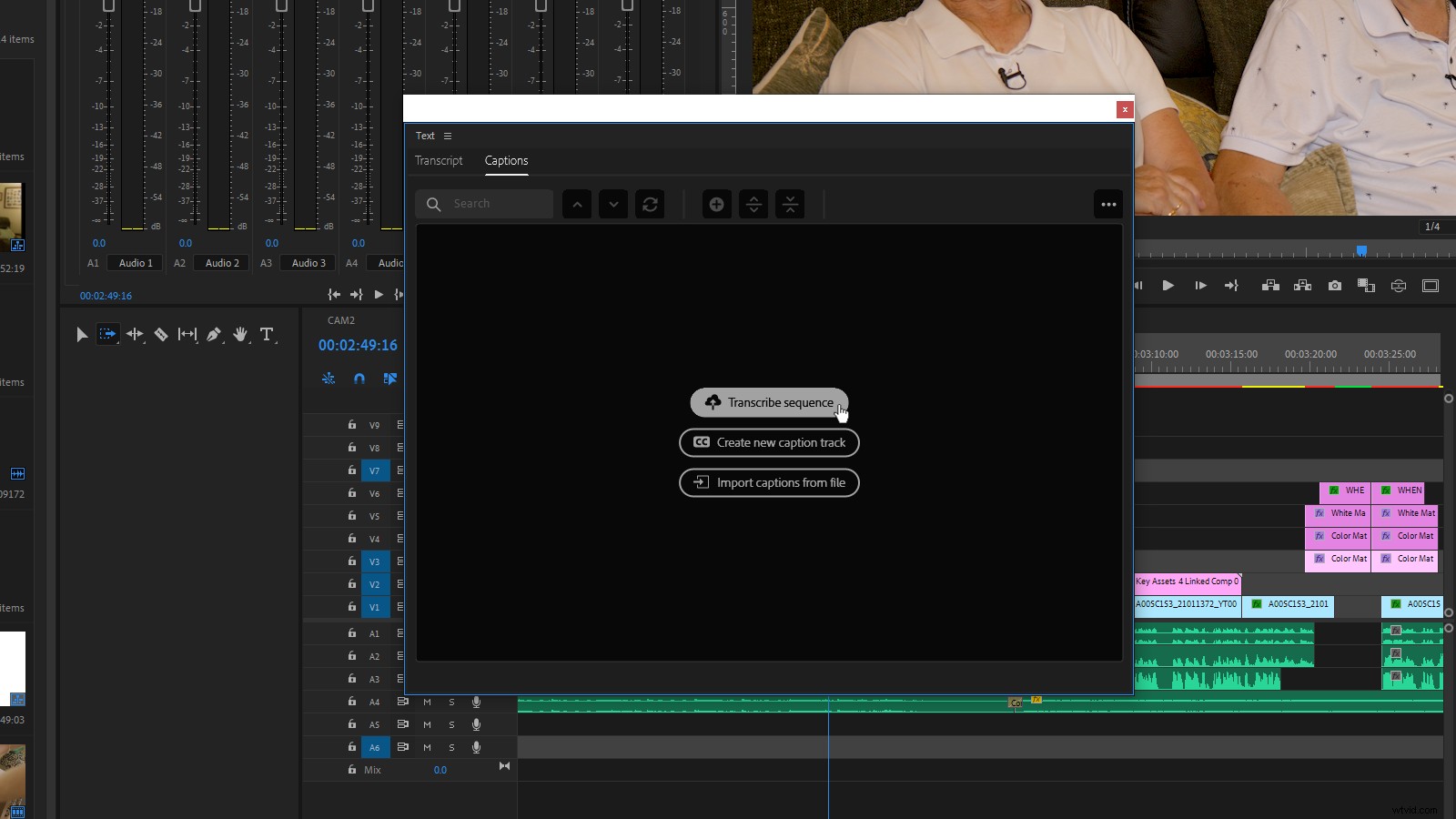

Om aan de slag te gaan, opent u het project dat u wilt ondertitelen in Premiere Pro en houdt u de doelreeks actief in de tijdlijnweergave.

Afhankelijk van hoe je je bewerking hebt gestructureerd, kan een kleine hoeveelheid voorbereiding nuttig zijn voordat je verder gaat.

Als u bijvoorbeeld meerdere vocalen op afzonderlijke tracks hebt ingedeeld, of als u een mix van zang en SFX/muziek op dezelfde track, moet u wat tijd besteden aan het taggen van vocale clips als Dialogue met behulp van het Essential Sound Panel (u kunt er ook voor kiezen om ongewenste tracks op de tijdlijn te dempen als dat gemakkelijker is). het analyseert later.

Als u geen bijschriften voor de hele reeks wilt maken, moet u de In- en Uit-punten van de reeks instellen door de afspeelkop naar de vereiste posities te verplaatsen en respectievelijk op de I- en O-toetsen te drukken. (Merk op dat de werkgebiedbalk niet wordt gebruikt voor deze functie.)

Als u klaar bent, opent u het tekstvenster (Venster->Tekst) en drukt u op de Transcribe-reeks knop.

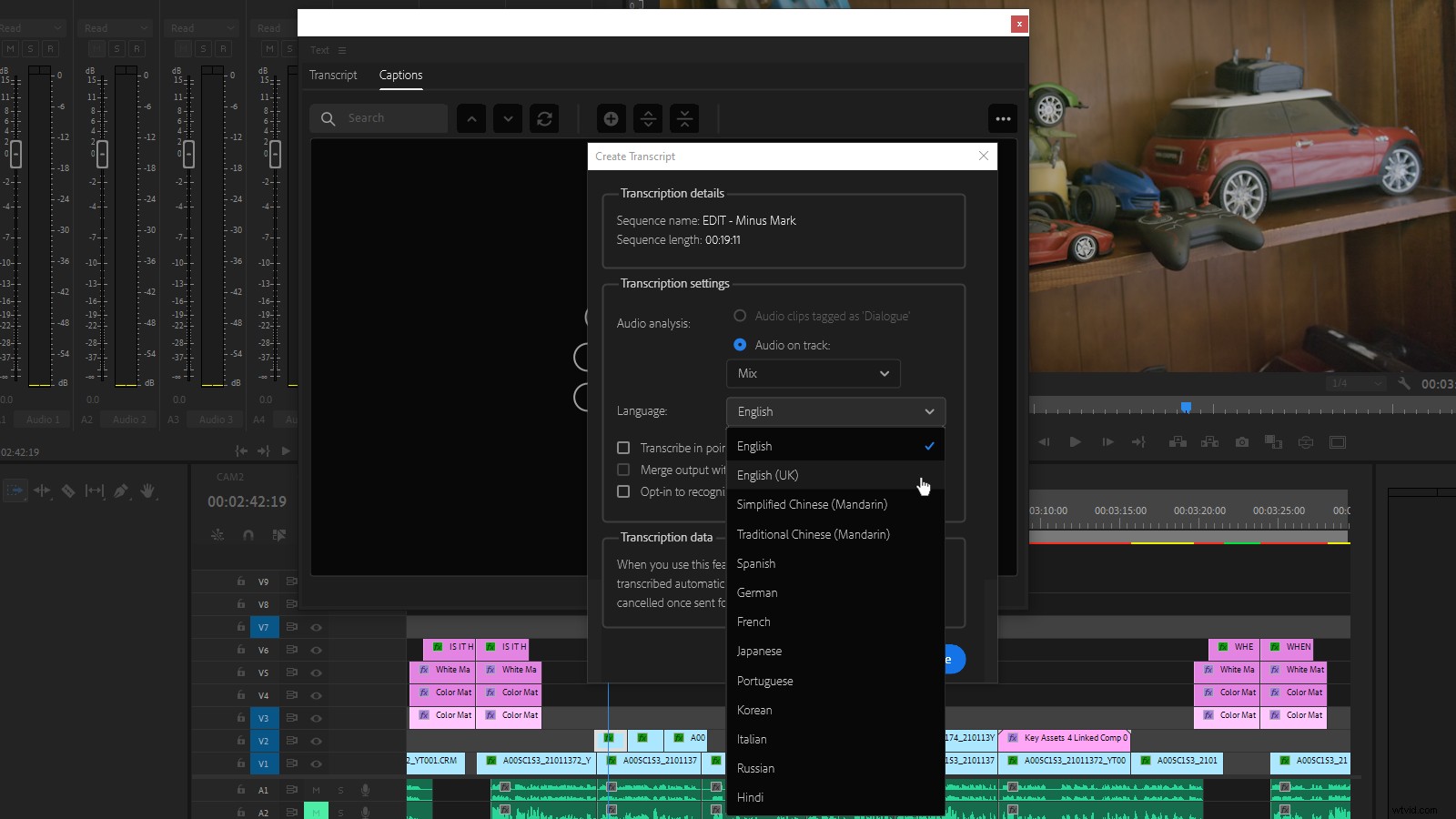

Uw opties op dit punt zijn eenvoudig. Je kunt ervoor kiezen om een mixdown te exporteren van alleen de clips die je hebt getagd als Dialogue, je kunt Mix kiezen om een mixdown van de hele reeks te maken, of je kunt een specifieke track selecteren om te exporteren uit het vervolgkeuzemenu.

Op dit moment is er geen manier om meerdere audiotracks voor de mixdown te selecteren, wat vervelend kan zijn als je meerdere luidsprekers op afzonderlijke tracks hebt. Demp voorlopig de tracks die u niet wilt opnemen en kies de optie Mix.

Speech-to-Text ondersteunt een indrukwekkende selectie talen die het grootste deel van de wereldbevolking bestrijkt. Opvallende uitzonderingen zijn Arabisch, Bengaals en Indonesisch, maar het is interessant om zowel Amerikaanse als Britse varianten van het Engels te zien. (Als Britse expat die in Australië woont, scoort laatstgenoemde bonuspunten bij mij.) Ik kan echter alleen in het Engels commentaar geven op de effectiviteit van de tool.

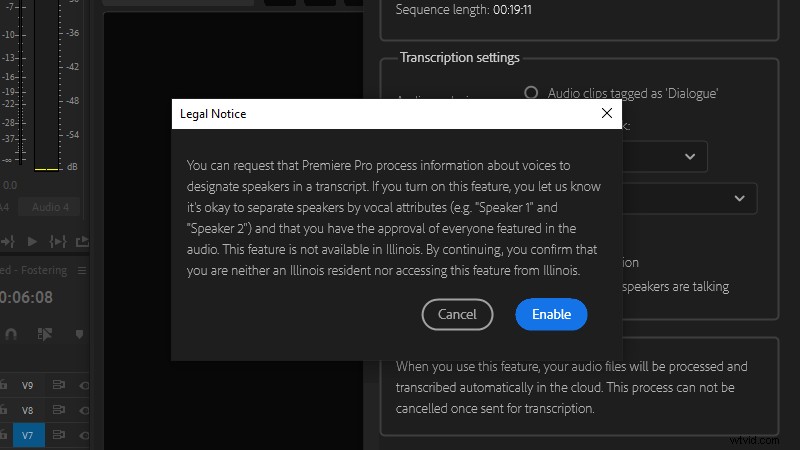

Het is interessant om op te merken dat Sensei's vermogen om verschillende sprekers te identificeren - wat het standaardgedrag in de bèta was - nu toestemming vereist en niet beschikbaar is in Illinois, vermoedelijk vanwege privacykwesties.

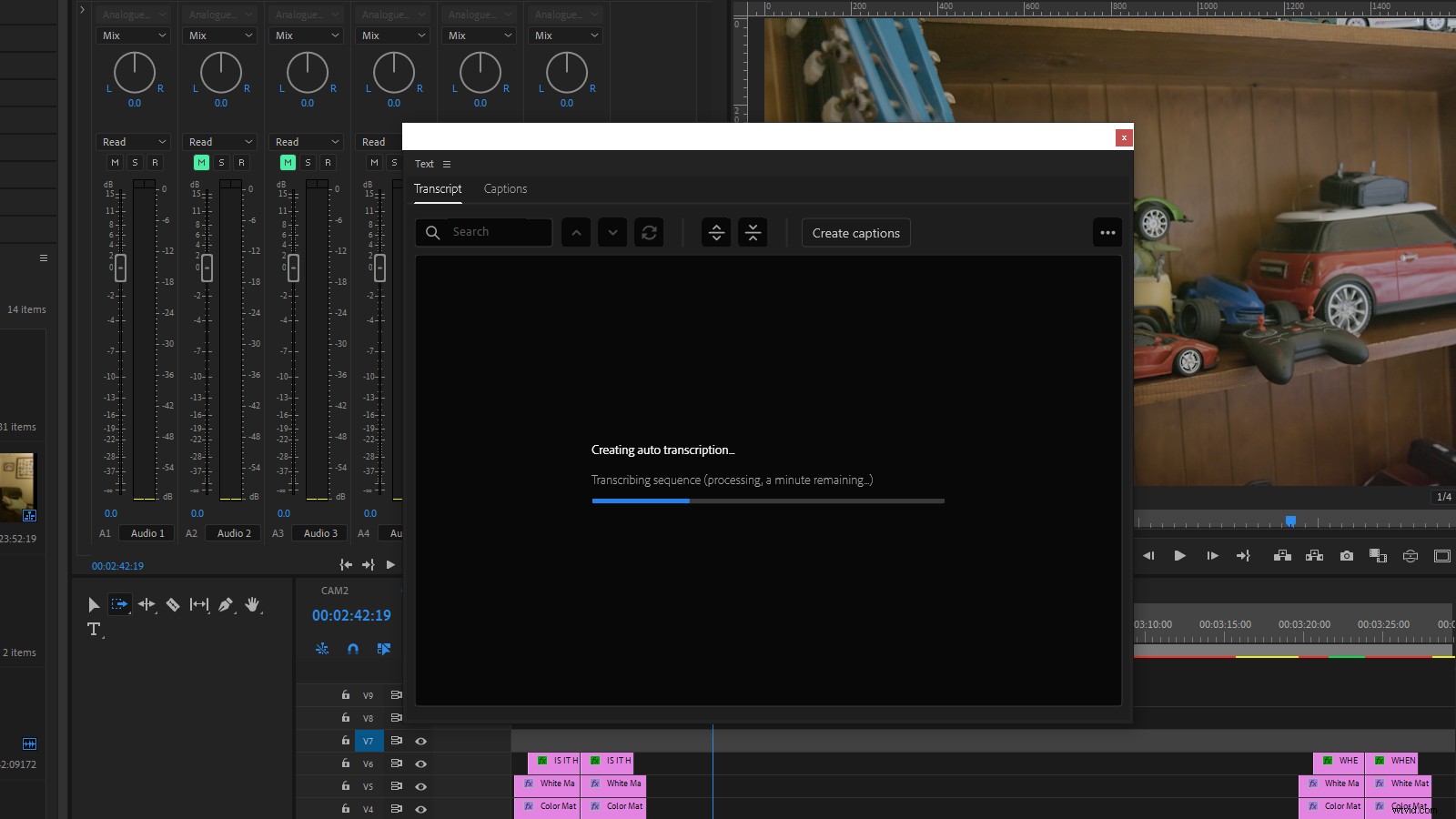

Het transcriptieproces is relatief snel, met een testproject van vier minuten met twee luidsprekers dat ongeveer twee minuten duurt, en een reeks van een uur die 24 minuten duurt, wat een doorlooptijd van ongeveer de helft van de looptijd aangeeft.

Maar Speech-to-Text is (meestal) cloudgebaseerd en het is onmogelijk om te voorspellen wat de snelheden zullen zijn als het hele Adobe Creative Cloud-lidmaatschap plotseling de rekencycli van Sensei op hetzelfde moment begint op te kauwen. Dat gezegd hebbende, zelfs als wachtrijen nodig worden, zullen jij en je werkstation in de tussentijd in ieder geval vrij zijn om die koffie te zetten of andere taken in te halen.

Ga weer aan het werk

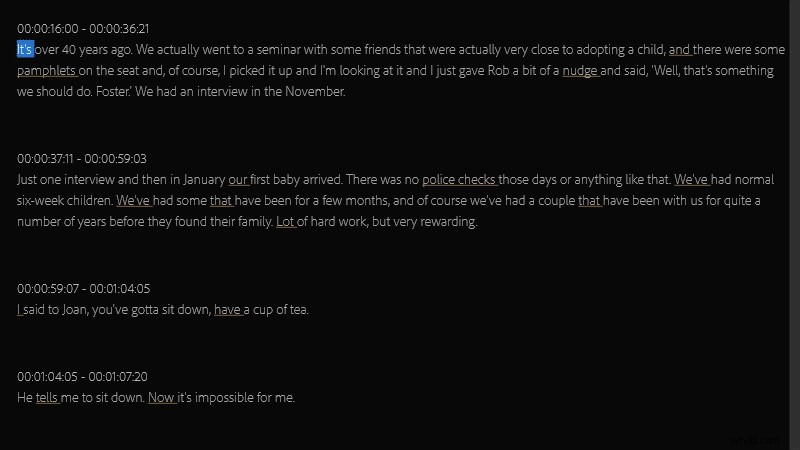

Wanneer Sensei klaar is met uw audio, wordt het tabblad Transcript van het Tekstpaneel gevuld met de resultaten.

En hoewel uw kilometerstand kan variëren, moet ik zeggen dat ik onder de indruk was van de nauwkeurigheid van de tests die ik heb uitgevoerd. De bètaversie die ik voor het eerst heb getest, was goed, de openbare versie is zelfs nog beter.

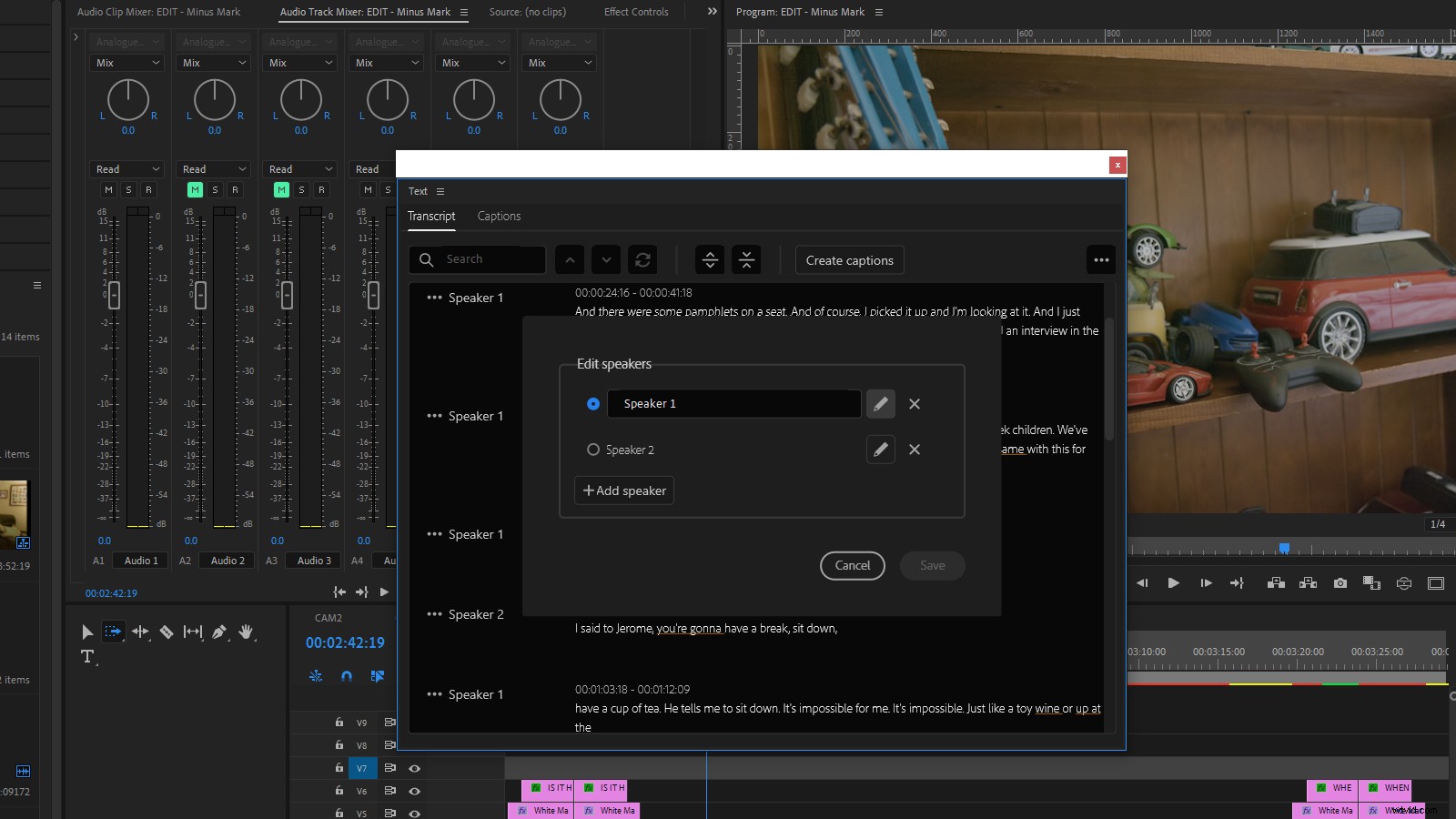

Door zich aan te melden voor sprekerprofilering, herkent Sensei meerdere sprekers en identificeert ze als Spreker 1, Spreker 2, enz. Als u zich afmeldt, wordt er gewoon Onbekend weergegeven naast de alineasegmenten.

U kunt ze hoe dan ook een naam geven door op het weglatingsteken in de linkerkolom van het tabblad Transcriptie te klikken en Sprekers bewerken te selecteren.

Met deze tool kun je handmatig gevallen herstellen waarin Sensei mogelijk onjuist geïdentificeerde luidsprekers met gelijkaardige stemmen heeft, en het is de moeite waard om hier nu de tijd voor te nemen voordat je verder gaat met het maken van ondertitels.

Hetzelfde geldt voor het opschonen van transcripten. Tenzij u extreem veel geluk hebt gehad met uw spraak-naar-tekst-analyse, zullen er fouten in uw transcriptie staan. Deze komen vaker voor bij opnames met een meer conversatie, achtergrondgeluid, niet-woordenboekwoorden zoals bedrijfsnamen of meerdere sprekers die door elkaar praten.

En hoewel u de tekst kunt bewerken nadat deze is omgezet in bijschriften, moet u de transcriptie voor corrigeren je komt bij de volgende stap. Dit komt omdat Premiere Pro de transcriptie en de daaropvolgende bijschriften als afzonderlijke gegevensbronnen behandelt, dus het aanbrengen van wijzigingen in de ene heeft geen effect op de andere.

Neem dus de tijd om je transcript goed te krijgen, want het is de bron van waaruit al je ondertitels worden gemaakt.

Verplaatsingen

Adobe heeft een aantal uiterst handige functies geïmplementeerd waarmee u tegelijkertijd door de video en het transcript kunt navigeren.

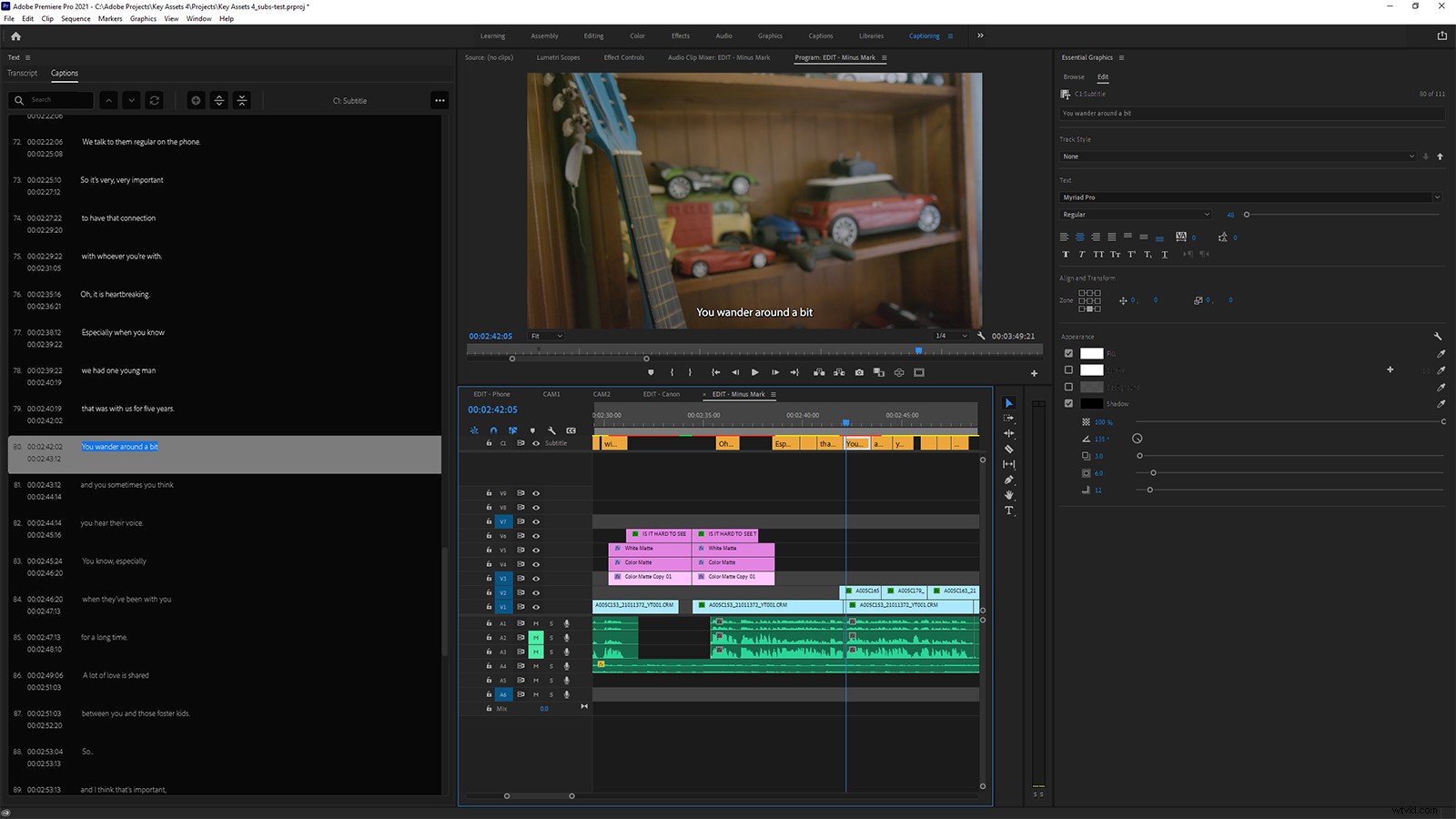

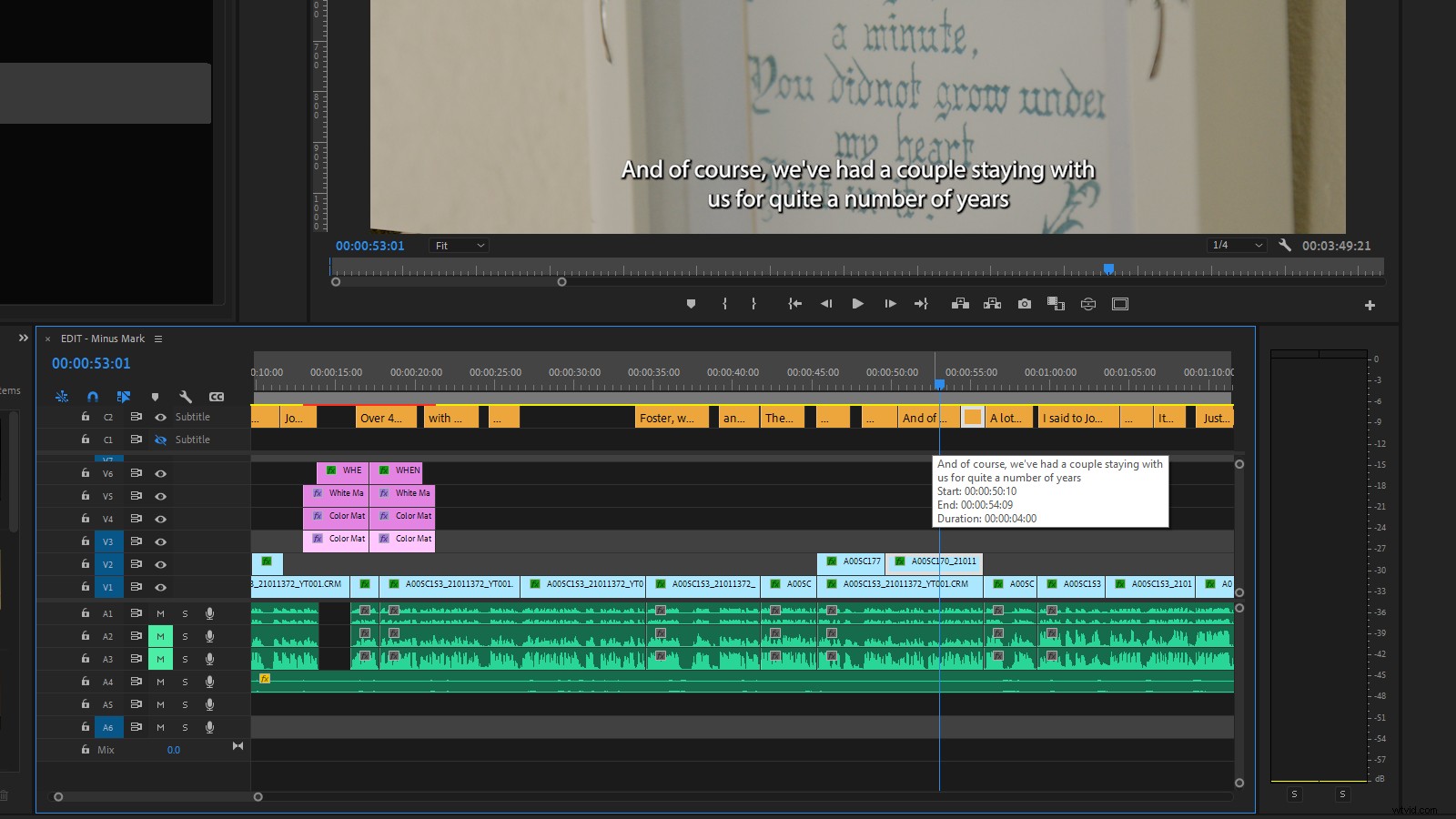

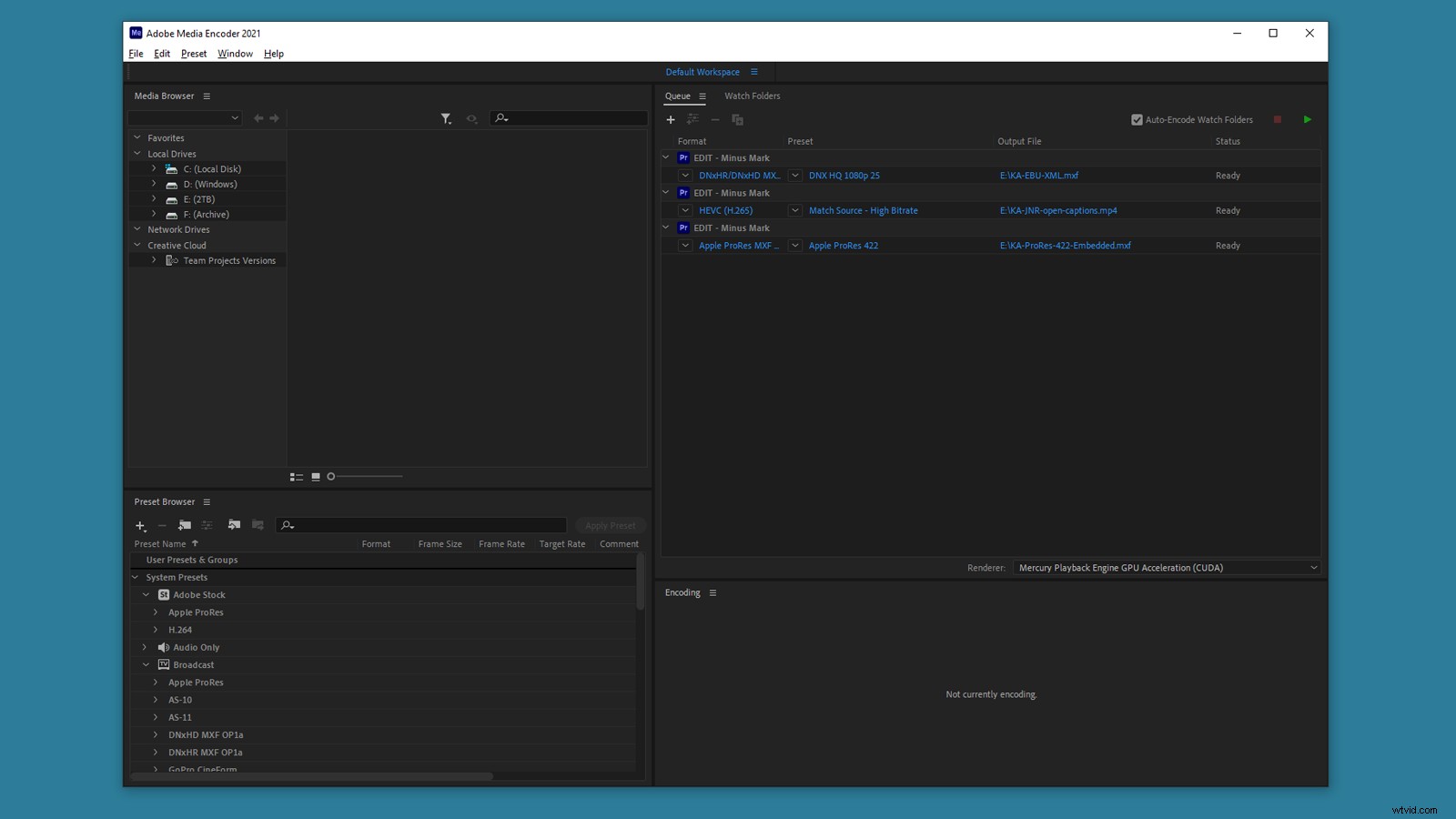

Om te beginnen heeft Premiere Pro al een werkruimte voor ondertitels die uw scherm verdeelt in tekst, essentiële afbeeldingen, tijdlijn, projectbakken en programma. Hoewel je misschien dingen wilt aanpassen aan je voorkeur. Voor mij ziet het er zo uit...

Als je eenmaal bent ingesteld, is het eenvoudig om je weg te vinden.

Als u bijvoorbeeld de afspeelkop naar een nieuwe positie in de tijdlijn verplaatst, wordt het transcript automatisch naar de overeenkomstige locatie gestuurd, in die mate dat het woord dat op dat punt onder de afspeelkop wordt uitgesproken, blauw wordt gemarkeerd in het deelvenster Transcript. Alle tekst die vóór de positie van de afspeelkop ligt, is grijs gekleurd, wat een nuttige toevoeging is aan de UX.

Op dezelfde manier zal het afspelen of schrobben van de tijdlijn de transcriptweergave bijwerken om gelijke tred te houden met de afspeelkop.

En het werkt ook omgekeerd, dus als u een woord selecteert in het deelvenster Transcript, worden de afspeelkop en het videovoorbeeld automatisch naar de overeenkomstige tijd in de reeks verplaatst. Het reageert soms wat traag, mogelijk omdat het met de servers van Adobe praat, maar het is niettemin een zeer effectieve aanpak.

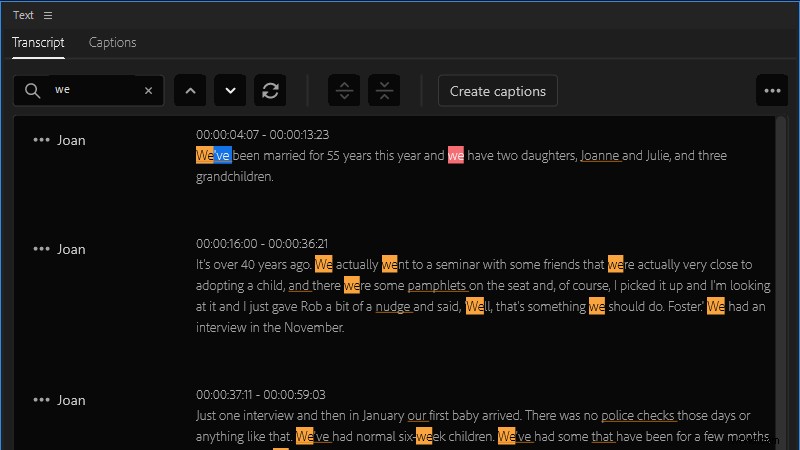

Er is ook een zoekvak in de bovenhoek, waarmee u naar woorden en woordgroepen in de transcriptie kunt springen, evenals een functie Vervangen als u herhaalde fouten moet herstellen.

Beste werkwijze

In dit stadium zult u waarschijnlijk het grootste deel van uw navigatie in het deelvenster Transcriptie uitvoeren; een woord selecteren, op de spatiebalk drukken om het afspelen te starten, vergelijken wat je hoort met wat je leest, dan stoppen en dubbelklikken op de tekst om wijzigingen aan te brengen.

Op basis van mijn ervaring zullen uw wijzigingen hoogstwaarschijnlijk gericht zijn op interpunctie en zinsstructuur, in plaats van het corrigeren van onjuiste woorden. En ondanks de inspanningen van Sensei, zul je nog steeds je best moeten doen om de zaken gereed te maken voor ondertiteling.

En dit is te verwachten. Natuurlijke taalverwerking is ongelooflijk moeilijk. Nadat je accenten, dialect, maniertjes, toon en nadruk hebt meegenomen, worstelen zelfs mensen ermee. Het is dus onrealistisch om perfecte resultaten van een machine te verwachten. (Ik raad je ten zeerste aan de automatische ondertiteling van YouTube in te schakelen voor het volgende videovoorbeeld.)

(Dit is een geweldig alternatief – https://youtu.be/Gib916jJW1o)

Benader deze fase dus met een open geest, een verse kop koffie en een comfortabele stoel. En als je advies nodig hebt over de beste werkwijzen voor het maken van ondertitels, lees dan eerst de richtlijnen voor ondertiteling van de BBC door.

Onthoud ook dat de transcriptiegegevens worden opgeslagen in het Premiere Pro-projectbestand, zodat u er later op terug kunt komen als dat nodig is. U kunt het transcript ook exporteren als een afzonderlijk, maar eigen .prtranscript bestand, hoewel het niet duidelijk is wat het voordeel van deze aanpak zou kunnen zijn.

Klaar?

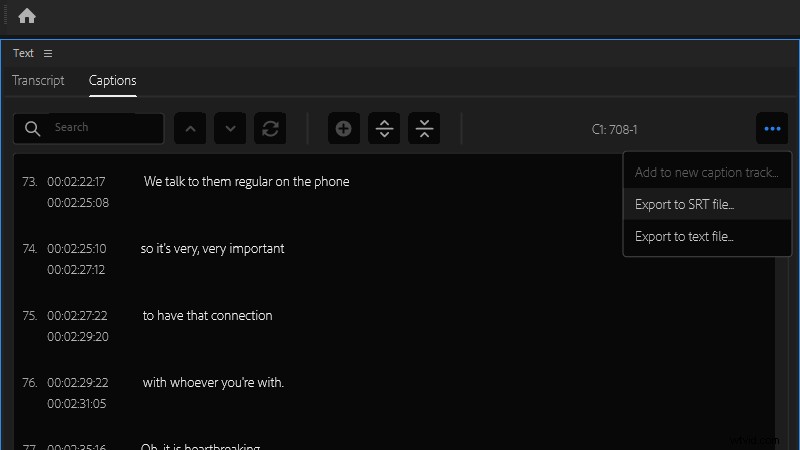

Als je zeker weet dat je transcript zo schoon is als je maar kunt maken, ga je gang en klik je op Bijschriften maken knop.

Je krijgt hier een heleboel opties, waaronder de mogelijkheid om stijlen toe te passen (ervan uitgaande dat je er eerder een aantal hebt gemaakt). U kunt de maximale tekenlengte en minimale duur van uw bijschriften definiëren, ze instellen op dubbele of enkele regel en zelfs het aantal frames dat u ertussen wilt invoegen.

Als je in dit stadium niet zeker weet wat je wilt, raad ik je aan om het formaat "Ondertitel" te kiezen in de vervolgkeuzelijst, en ervoor te zorgen dat de Maken van sequentietranscript keuzerondje is geselecteerd en laat de rest op hun standaardwaarden staan.

Ik ga niet veel tijd besteden aan het bespreken van de verschillende ondertitelingsformaten die Speech-to-Text biedt. Deels omdat ik geen expert ben in de verschillen, en u uw projectvereisten beter kent dan ik. Maar vooral omdat het er niet zoveel toe doet .

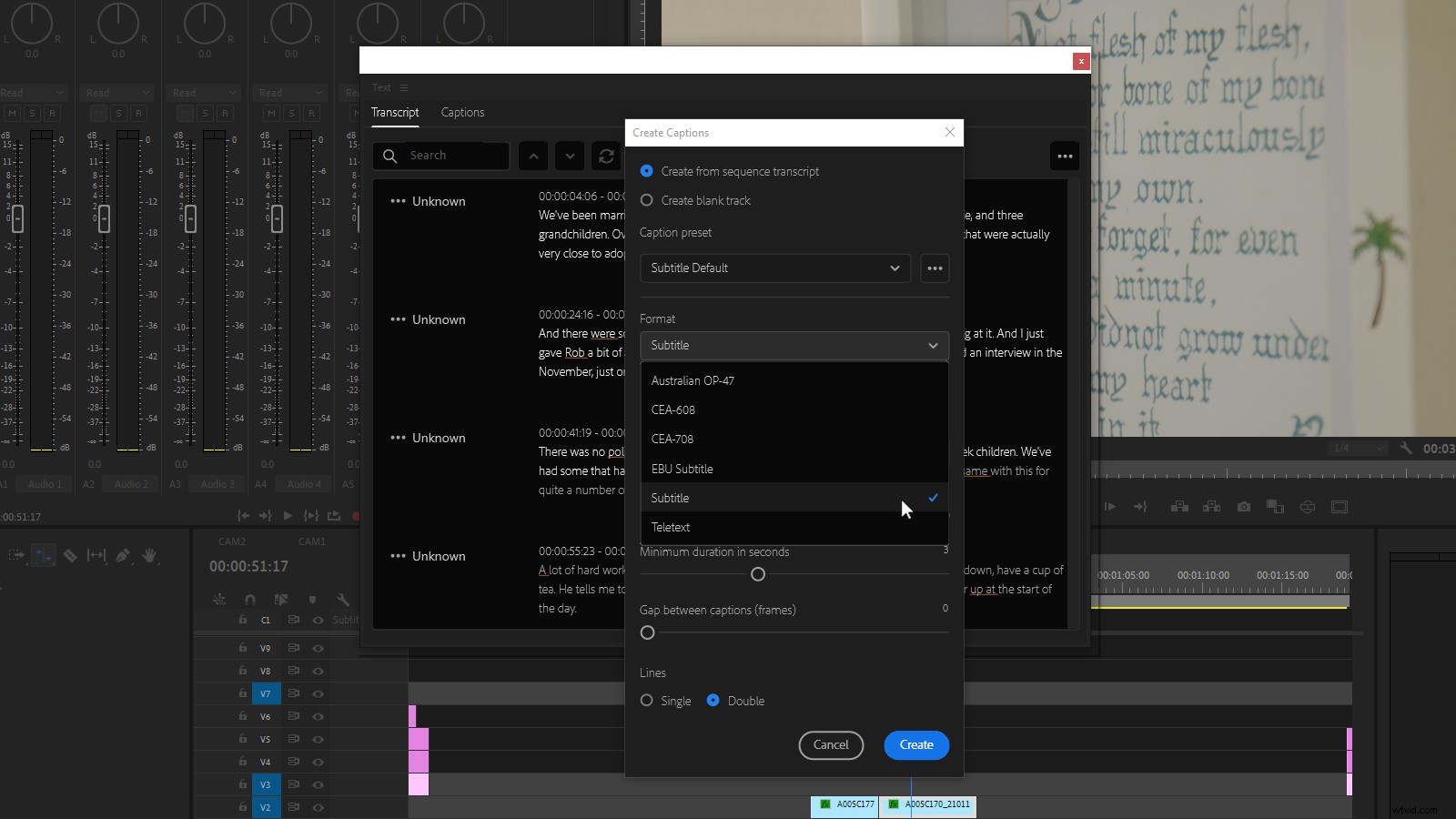

Dit komt omdat Speech-to-Text van Premiere Pro uw transcriptgegevens intact houdt en uw bijschriften toevoegt aan een afzonderlijk nummer in de reekstijdlijn. (Dit is een enorme verbetering ten opzichte van Premiere Pro's eerste poging tot ondertiteling, waarbij de ondertitelingstrack in de videolaag werd opgenomen.)

Hierdoor kunt u bijschriften in zoveel verschillende formaten genereren als u nodig heeft. Zelfs met terugwerkende kracht, mocht uw project worden verkocht in een gebied dat een andere standaard gebruikt. Er lijkt geen limiet te zijn aan het aantal ondertitelingstracks dat u kunt toevoegen, en de indeling die voor elke ondertitelingstrack wordt gebruikt, is duidelijk gelabeld.

Als het rommelig begint te worden, kun je de trackzichtbaarheid wijzigen met de CC-knop in de tijdlijnweergave.

Als u met ondertiteling in vreemde talen werkt, kan dit aspect van de gebruikersinterface zeer nuttig zijn, omdat u hiermee ondertitelingslagen kunt maken voor zoveel talen als u nodig heeft in dezelfde tijdlijn met volgorde . Er zijn beperkingen aan deze benadering, waar ik later op terugkom, maar als ik uit persoonlijke ervaring spreek, juich ik dit van harte toe.

Dus ga je gang en druk op die knop Maken en kijk hoe je transcript wordt opgedeeld en opgemaakt in het formaat van je keuze.

Nog een ronde

Als je enige ervaring hebt met het maken van ondertitels, weet je dat goede ondertitels verrassend veel finesse vereisen.

Het is niet zo eenvoudig als de dialoog in zinnen opbreken en ze op het scherm laten zien zolang de spreker ze nodig heeft om ze uit te spreken.

Je moet het gesproken woord deconstrueren in korte, begrijpelijke secties die kunnen worden gelezen zonder al te veel aandacht van de beelden af te leiden. Interpunctie is ongelooflijk belangrijk en regeleinden kunnen het verschil betekenen tussen begrip en verwarring. En om eerlijk te zijn lijkt Speech-to-Text hier redelijk in te slagen.

Om echter te voldoen aan ondertitelingsnormen zoals de FCC's, moet u geluid en muziek in de ruimst mogelijke mate overbrengen . En hoewel het onredelijk is om te verwachten dat Sensei geluiden en muziek gaat labelen (voorlopig tenminste), zou je ondertitelingssoftware je in staat moeten stellen informatie op te nemen die verder gaat dan dialoog.

Een voor een, alstublieft

Spraak-naar-tekst is helaas beperkt tot een enkele track zonder ruimte voor overlappende elementen.

Dit betekent dat er geen manier is om eenvoudig gelijktijdige luidsprekers op te nemen of geluids- of muziek-ID's toe te voegen via dialoog. (Ik heb geprobeerd deze toe te voegen aan een tweede ondertitelingstrack, maar je kunt de zichtbaarheid slechts voor één track tegelijk inschakelen.)

Dus als FCC-compliance nodig is voor uw project, moet u deze taak mogelijk overdragen aan een andere ondertitelingsoplossing. Maar zelfs dan kunt u nog steeds spraak-naar-tekst gebruiken om u het meeste uit de weg te ruimen en de resultaten vervolgens exporteren naar een tekst- of SRT-bestand (SubRip) om te importeren in een andere tool.

Verdeel het verschil

Als je eenmaal bezig bent met het bewerken van de ondertitels die worden gegenereerd door spraak-naar-tekst, is de workflow van Premiere Pro heel logisch.

Zinnen zijn opgedeeld in korte segmenten van één regel die zelfs op de kleinste schermen passen zonder regeltjes. En je kunt ervoor kiezen om deze samen te voegen of verder te splitsen als ze niet helemaal werken in hun huidige staat.

Het toevoegen van nieuwe bijschriften is ook mogelijk, ervan uitgaande dat er ruimte is om dit te doen (de standaard voor het ingevoegde bijschrift is drie seconden, en u kunt bestaande bijschriften overschrijven als u hier niet voorzichtig bent).

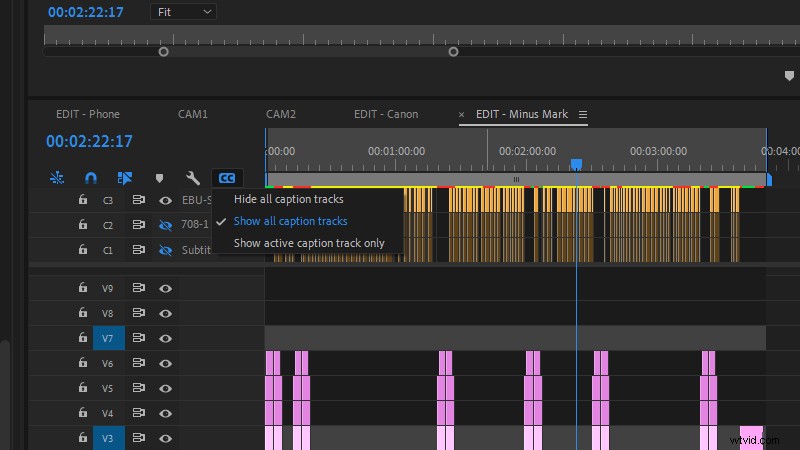

Bijschriften gedragen zich ook als elk ander item in de tijdlijn. Je kunt dus hun in- en uitpunten aanpassen door cliphandvatten te slepen, ze aan videoclips te koppelen, ze te splitsen met het scheermesje, of zelfs slip-, schuif-, rimpel- en rolbewerkingen uit te voeren.

Dus als je al de weg weet in de Premiere Pro-toolset, komen je bestaande vaardigheden hier goed van pas.

Repareren in post-post

Er is echter een beperking voor het bewerken van nummers die uniek is voor ondertiteling.

Hoewel u meerdere video-, audio- of afbeeldingstracks tegelijkertijd kunt selecteren en manipuleren, kan er slechts één ondertitelingstrack tegelijk actief zijn. Als u meerdere ondertitelingstracks in verschillende indelingen moet aanpassen, moet u dit één track tegelijk doen.

Maar dit voelt als haren splijten. Aangezien het ondertitelingsproces doorgaans plaatsvindt lang nadat de bewerking is vergrendeld en goedgekeurd, moet de noodzaak om wijzigingen aan te brengen in meerdere ondertitelingsindelingen moeten een randscenario zijn.

Open of gesloten?

Premiere Pro biedt een breed scala aan opmaakhulpmiddelen voor uw bijschriften, waaronder de mogelijkheid om stijlen op te slaan en toe te passen op toekomstige projecten.

U kunt opties voor lettertype, kleur, schaduw, omtrek en achtergrond aanpassen, evenals positie, tekstuitlijning en bruikbaar bijschriftgebied. En deze kunnen worden toegewezen aan individuele ondertitels of aan de hele ondertitelingstrack.

Ondertiteling

Maar de mate waarin u het uiterlijk van uw bijschriften kunt wijzigen, hangt af van of u van plan bent ze te implementeren als open of gesloten .

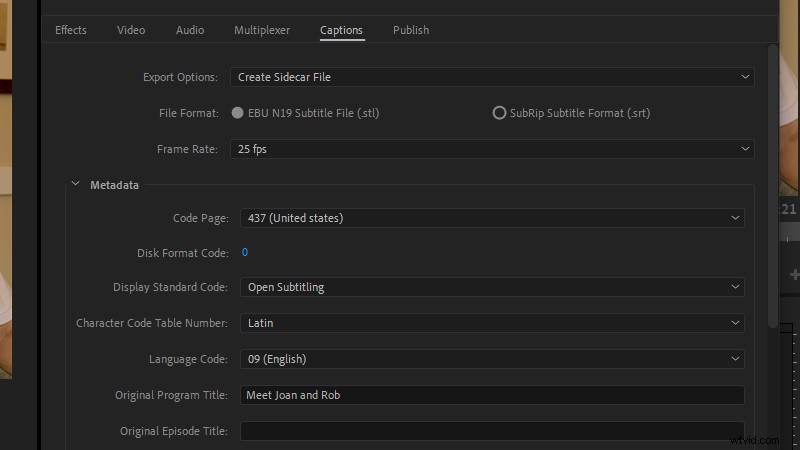

Ondertitels worden opgeslagen als afzonderlijke bestanden, ook wel sidecar-bestanden genoemd, en kunnen tijdens het afspelen door de kijker worden in- en uitgeschakeld.

De meeste opmaak voor ondertitels wordt afgehandeld door het afspeelsysteem, dus de opmaakopties zijn beperkt (en Premiere Pro geeft alleen functies weer die worden ondersteund door het door u gekozen ondertitelingsformaat). Maar ondanks de naam zijn ondertitels gemakkelijker te wijzigen nadat ze zijn voltooid, omdat ze meestal een eenvoudig tekst- of XML-bestand zijn.

Open ondertiteling

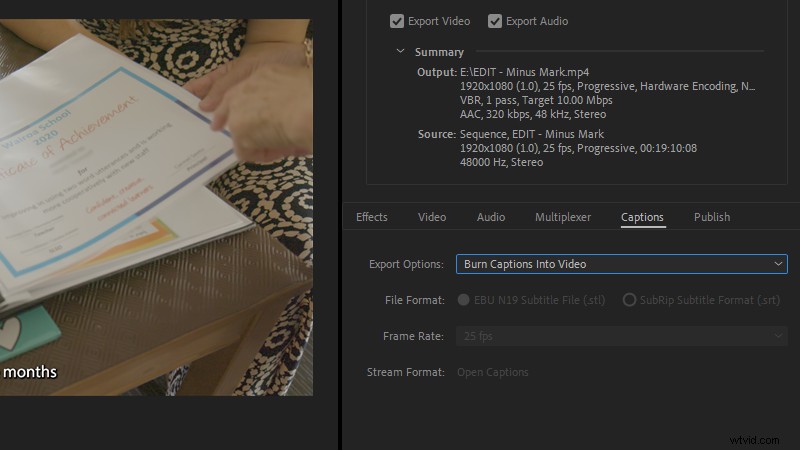

Open bijschriften daarentegen worden in de video 'ingebrand', zodat ze altijd zichtbaar zijn (ongeacht het afspeelplatform of apparaat) en je kunt ze naar eigen inzicht opmaken.

Het betekent ook dat je één versie van de ondertitelde video kunt maken die op alle videoplatforms kan worden afgespeeld.

Maar de wisselwerking hier is dat je ondertiteling niet kan worden gewijzigd zonder de hele video opnieuw te renderen en opnieuw te distribueren. En als je met meerdere talen werkt, moet je voor elke taal geheel nieuwe video's maken in plaats van een beter beheersbare set ondertitelingstracks.

Het is ook vermeldenswaard dat open bijschriften samen met de video van formaat veranderen, dus als je publiek op een mobiel apparaat naar een stuk 16×9 media in staande weergave kijkt, bestaat de kans dat je bijschriften te klein worden om te lezen.

Op basis hiervan zou je denken dat er geen dwingende reden is om te kiezen voor open bijschriften bij je video-inhoud. Maar als u publiceert op sociale media, wilt u misschien niet vertrouwen op de automatische ondertitelingstools die momenteel uw enige optie zijn op platforms zoals Instagram of TikTok.

Op sommige sociale platforms kun je ook alleen ondertiteling toevoegen op het moment dat je de video uploadt, waardoor het plannen of automatisch plaatsen van video-inhoud met bijschriften onmogelijk is. Dus open ondertiteling kan nog steeds een haalbare optie zijn.

| YouTube | TikTok | ||||

| Upload ondertitels | Y | Y | Y | Y | N |

| Bijschriften automatisch genereren | Y | Y | N | N | Y |

| Plan ondertitelde video | Y | Y | N | N | N |

Eindigen

Als we naar de huidige versie kijken, lijkt het alsof uw exportopties zijn teruggebracht tot EBU N19 of platte tekst SubRip SRT-bestand - het MacCaption VANC MCC-formaat en Insluiten in uitvoerbestand optie gevonden in de bèta zijn niet langer beschikbaar.

Dit is echter niet zo beperkend als het klinkt, aangezien EBU de meeste streaming- en uitzenddiensten bedient en SRT de meeste online en sociale videoplatforms bestrijkt.

Wat we niet zien, is de mogelijkheid om alleen . te exporteren de ondertitelingstrack van de exporttool van Premiere Pro of Adobe Media Encoder, dus u moet ten minste een audiobestand weergeven om een XML-ondertitelingsbestand te krijgen.

Gezien het feit dat je vanuit het deelvenster Ondertitels kunt exporteren naar .srt- en .txt-bestanden, lijkt dit vreemd en het lijkt erop dat dit in de toekomst zal veranderen.

Als u open ondertiteling wilt, kunt u gewoon de optie Brand ondertitels in video . kiezen keuze. En natuurlijk, als je meerdere exports in verschillende formaten wilt maken, kun je ze in de wachtrij plaatsen in Adobe Media Encoder voor batchexport. Zorg ervoor dat u eerst de zichtbaarheid van de vereiste ondertitelingstrack in de tijdlijn instelt.

Wat ontbreekt er?

Tijdens het testen van de bèta heb ik enkele gebieden opgemerkt waar Adobe deze tool zou kunnen verbeteren voordat deze voor het publiek wordt vrijgegeven en, met een kleine uitzondering, ze nog steeds "ontbreken". Dus hier is mijn verlanglijstje:

- Aanpasbare lettergrootte in de deelvensters Transcript en Bijschriften.

De tekstgrootte wordt momenteel bepaald door de systeeminstellingen, en soms wilde ik de lettergrootte vergroten om dingen gemakkelijker te kunnen lezen tijdens het bewerken van het transcript. - Script importeren.

Als je met gescript materiaal werkt, kan Speech-to-Text in theorie het transcriptieproces overslaan en in plaats daarvan focussen op timing. Dit zou u in staat stellen om wat u al heeft snel om te zetten in een formaat dat gereed is voor ondertiteling. (YouTube heeft dit al.) - Aangepaste opmaak op basis van spreker.

Hoewel je de sprekers in het transcript kunt identificeren, is er geen manier om die gegevens automatisch aan je ondertiteling toe te voegen. En als je scène voor scène ondertitelt, kan het handig zijn om aangepaste bijschriften te plaatsen voor sprekers die zich altijd aan een bepaalde kant van het frame zullen bevinden.

Maar is het het waard?

Ik kan niet zeggen wat uw ervaring met Speech-to-Text van Premiere Pro is.

Is het automatisering met één knop voor al uw ondertitelingsbehoeften? Natuurlijk niet. En ik geloof dat we nog ver verwijderd zijn van het bouwen van een systeem dat deze complexe en oneindig variabele taak aankan zonder enige vorm van menselijke tussenkomst.

Maar voor mij werd deze tool een standaard opname in mijn toolkit voordat hij de bèta verliet.

If pressed, I’d estimate that it’s cut the time it takes to caption content to about a third of what it was before . It’s not the only option available—Otter.ai will export transcripts to the .srt caption format, Digital Anarchy has a Premiere Pro plugin called Transcriptive, and of course, you can pay companies to do the job for you—but all of these have a cost component, while Speech-to-Text is currently free to use.

It all comes back to that comment I included at the beginning of this article—is it easier to use Speech-to-Text than it would be to transcribe it yourself? For me, the answer is a very firm yes. So if you’re looking at finding a better way to add accessibility and greater audience engagement to your video projects, Premiere Pro Speech-to-Text is definitely worth a look.

(And if you’re looking for more content on working with audio in Premiere Pro, check out Premiere Pro Mixing Basics and Premiere Pro Audio Tools.)