Heeft u zich ooit afgevraagd hoe moeiteloos gesproken zoeken op Google aanvoelt? Het antwoord ligt in de automatische spraakherkenningstechnologie (ASR), die gesproken taal in realtime naar tekst vertaalt.

Terwijl basishulpmiddelen voor spraak-naar-tekst alleen maar woorden transcriberen, maken geavanceerde ASR-systemen gebruik van kunstmatige intelligentie en machinaal leren om een hogere nauwkeurigheid te leveren, diverse accenten te herkennen, achtergrondgeluiden te filteren en de contextuele betekenis te begrijpen. Dit maakt ze onmisbaar voor virtuele assistenten, klantenservicebots en gesproken zoekmachines.

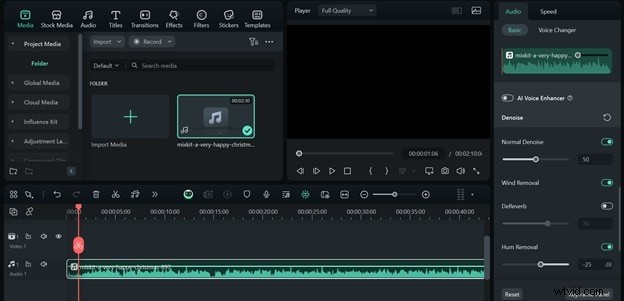

In deze gids leggen we uit hoe ASR werkt, ontkrachten we veelvoorkomende mythen, onderzoeken we toepassingen in de echte wereld (zoals het videobewerkingspakket van Filmora) en schetsen we toekomstige uitdagingen en kansen.

In dit artikel

- Wat is een automatisch spraakherkenningssysteem en hoe werken ze?

- Gemeenschappelijke mythen over ASR-systemen versus feiten

- Hoe u automatische spraakherkenningstechnologie gebruikt

- Uitdagingen met ASR-applicaties en toekomstige voortgang

Deel 1:Wat is een automatisch spraakherkenningssysteem en hoe werken ze?

Automatische spraakherkenning transformeert gesproken woorden in geschreven tekst door AI, machine learning en taalmodellen toe te passen om audiosignalen te analyseren en interpreteren. Het ondersteunt stemassistenten zoals Siri en Alexa, stuurt transcriptiediensten aan, ondersteunt callcenteranalyses en ondersteunt realtime vertaaltools.

Het proces gaat verder dan alleen luisteren. Zo werkt een ASR-systeem doorgaans:

Hoe werken ASR-systemen?

- Spraak wordt vastgelegd via een microfoon of een geüpload audiobestand.

- Voorverwerking zuivert het signaal, vermindert ruis en verbetert de helderheid.

- De audio wordt gesegmenteerd in korte frames en kenmerken zoals toonhoogte, toon en ritme worden geëxtraheerd.

- Een akoestisch model, getraind op grote spraakcorpora, brengt deze kenmerken in kaart in foneemwaarschijnlijkheden.

- Een taalmodel voorspelt de meest waarschijnlijke woordreeksen op basis van grammatica, veelgebruikte zinnen en syntaxis, en lost dubbelzinnigheden op (bijvoorbeeld door onderscheid te maken tussen 'spraak herkennen' en 'een mooi strand verwoesten').

- Een decoderingsalgoritme combineert akoestisch bewijs en taalbewijs om de uiteindelijke transcriptie uit te voeren, vaak in milliseconden.

State-of-the-art ASR-systemen maken gebruik van diepe neurale netwerken die voortdurend voorspellingen verfijnen terwijl ze leren van gebruikerscorrecties, waardoor de nauwkeurigheid gestaag toeneemt.

Deel 2:Veel voorkomende mythen over ASR-systemen versus feiten

Ondanks de wijdverbreide acceptatie blijven er misvattingen bestaan over de mogelijkheden van ASR.

| Mythen | Feiten |

| ASR-systemen zijn 100% nauwkeurig | Zelfs toonaangevende modellen, zoals Google's Speech-to-Text en OpenAI's Whisper, interpreteren spraak af en toe verkeerd vanwege achtergrondgeluid of atypische accenten. Nabewerking blijft raadzaam, vooral voor kritische toepassingen. |

| ASR-systemen begrijpen taal zoals mensen | ASR is gebaseerd op het matchen van statistische patronen in plaats van op semantisch begrip. Het koppelt geluiden aan woorden met behulp van probabilistische modellen (HMM's, diepe neurale netten), maar mist een echt begrip van de betekenis. |